Introduction : pourquoi l'IA est devenue incontournable en 2026

L'intelligence artificielle n'est plus une technologie futuriste réservée aux laboratoires de recherche. Depuis quelques mois, elle s'est imposée comme un outil quotidien dans presque tous les secteurs professionnels. L'explosion des modèles de langage (LLM), la démocratisation d'outils accessibles comme ChatGPT, Claude ou Copilot, et l'intégration massive de l'IA dans les logiciels standards transforment radicalement nos manières de travailler.

Cette révolution soulève des enjeux majeurs et multiples. La productivité s'envole : des tâches qui prenaient des heures s'accomplissent désormais en minutes. L'innovation s'accélère grâce à des capacités d'analyse et de génération inédites. Mais cette transformation pose également des questions éthiques cruciales sur les biais algorithmiques, la protection des données, la souveraineté numérique et l'impact sur l'emploi.

Pour naviguer efficacement dans cette nouvelle ère, comprendre l'histoire de l'IA devient essentiel. D'où vient cette technologie ? Comment a-t-elle évolué ? Quelles sont ses applications concrètes aujourd'hui ? Quelles opportunités pour la société ? Cet article retrace le parcours de l'intelligence artificielle, des premières théories aux agents autonomes actuels, et explore ses impacts réels sur le monde professionnel.

L'histoire de l'intelligence artificielle : des fondations théoriques aux révolutions modernes

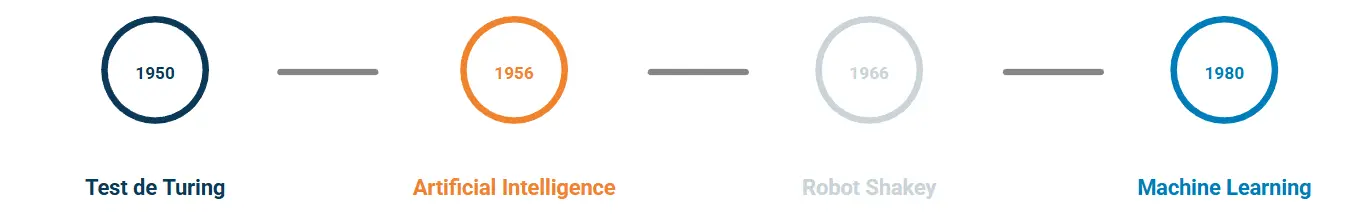

1950-1980 : Les fondations théoriques et les premiers pas

L'histoire moderne de l'IA commence en 1950 avec Alan Turing et son célèbre test. Le mathématicien britannique pose une question fondamentale : une machine peut-elle penser ? Son test propose un critère pragmatique : si une machine peut converser avec un humain sans que celui-ci ne détecte qu'il parle à une machine, alors elle manifeste une forme d'intelligence.

Cette période voit naître la logique symbolique et les premiers algorithmes d'IA. Les chercheurs développent des systèmes capables de résoudre des problèmes mathématiques, de jouer aux échecs à un niveau basique ou de démontrer des théorèmes. Ces réalisations impressionnent, comme le Robot Shakey capable de raisonner sur ses actions, mais restent limitées à des domaines très spécifiques et contrôlés.

Le principal obstacle réside dans l'absence de puissance de calcul suffisante. Les ordinateurs de l'époque, massifs et coûteux, peinent à exécuter les algorithmes complexes imaginés par les chercheurs. Les applications réelles restent rares et principalement confinées aux laboratoires universitaires ou militaires. Cette limitation technique provoque plusieurs "hivers de l'IA" où l'enthousiasme initial cède la place à la désillusion face aux promesses non tenues.

1980-2012 : L'émergence du Machine Learning

Les années 1980 marquent un tournant avec l'apparition du Machine Learning. Plutôt que de programmer explicitement chaque règle, les chercheurs développent des algorithmes capables d'apprendre à partir de données. Les machines à vecteurs de support (SVM), les arbres de décision et les régressions statistiques permettent de créer des modèles prédictifs performants.

Cette approche génère les premiers systèmes commercialement viables. La reconnaissance optique de caractères (OCR) améliore drastiquement le traitement de documents. Les systèmes de recommandation apparaissent dans le e-commerce. Les filtres anti-spam deviennent efficaces. Toutefois, ces systèmes restent très spécialisés, nécessitant une expertise pointue pour chaque application.

L'événement symbolique de cette ère survient en 1997 quand Deep Blue, le superordinateur d'IBM, bat Garry Kasparov, champion du monde d'échecs. Cette victoire démontre que les machines peuvent surpasser l'humain dans des tâches requérant stratégie et calcul complexe. Elle marque également les limites de cette approche : Deep Blue excellait aux échecs mais ne pouvait rien faire d'autre.

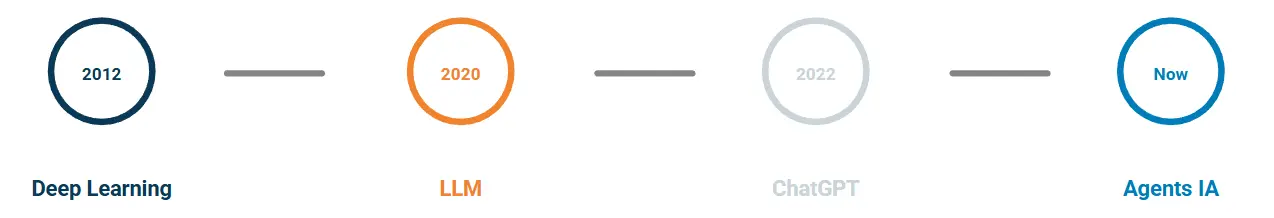

2012-2020 : La révolution du Deep Learning

L'année 2012 constitue un point de rupture majeur. L'arrivée des GPU (processeurs graphiques) comme accélérateurs de calcul décuple la puissance disponible pour entraîner des modèles d'IA. Cette explosion de capacité de calcul rend possible l'apprentissage profond (Deep Learning), utilisant des réseaux de neurones artificiels comportant des millions, puis des milliards de paramètres.

Les résultats dépassent rapidement toutes les attentes. En vision par ordinateur, les modèles surpassent les humains dans la reconnaissance d'objets sur images. En traitement du langage naturel (NLP), les systèmes comprennent et génèrent du texte avec une fluidité croissante. En reconnaissance vocale, les taux d'erreur s'effondrent. L'architecture Transformer, introduite en 2017, révolutionne le traitement séquentiel et pose les bases des futurs LLM.

Cette période voit des accomplissements spectaculaires. En 2015, AlphaGo de DeepMind bat le champion professionnel Lee Sedol au jeu de Go, un exploit considéré comme impossible quelques années auparavant en raison de la complexité combinatoire du jeu. En 2018, AlphaFold résout le problème de la structure des protéines, un défi scientifique majeur pendant des décennies, accélérant drastiquement la recherche biomédicale.

2020-2022 : L'ère des modèles de langage massifs

L'année 2020 marque l'avènement des grands modèles de langage (LLM) avec GPT-3 d'OpenAI. Ce modèle de 175 milliards de paramètres démontre des capacités étonnantes : générer du texte cohérent, écrire du code, traduire, résumer, raisonner sur des problèmes complexes. Pour la première fois, un seul modèle polyvalent remplace des dizaines de systèmes spécialisés.

En 2021, DALL-E introduit la génération d'images à partir de descriptions textuelles. Cette capacité multimodale ouvre des perspectives créatives inédites. Les artistes, designers et créateurs de contenu découvrent un nouvel outil d'exploration visuelle.

Le véritable tournant grand public survient en novembre 2022 avec le lancement de ChatGPT. Ce chatbot accessible à tous révèle au monde entier le potentiel de l'IA conversationnelle. En deux mois, il atteint 100 millions d'utilisateurs, devenant l'application à la croissance la plus rapide de l'histoire. Les entreprises, professionnels et particuliers découvrent qu'ils peuvent désormais dialoguer naturellement avec une IA pour obtenir de l'aide sur presque n'importe quel sujet.

2023 à aujourd'hui : Industrialisation et agents autonomes

Depuis 2023, l'IA entre dans une phase d'industrialisation accélérée. Les modèles deviennent multimodaux, traitant simultanément texte, images, audio et vidéo. Chaque mois apporte de nouveaux modèles avec des capacités améliorées : raisonnement plus profond, mémoire contextuelle étendue, spécialisation sur des domaines techniques.

La concurrence s'intensifie avec une multitude d'acteurs : OpenAI, Anthropic, Google, Meta, Mistral AI, et des dizaines d'autres proposent des modèles aux caractéristiques variées. Cette diversité offre des options adaptées à différents besoins : modèles ultra-performants pour les tâches complexes, modèles légers pour l'embarqué, modèles spécialisés pour la médecine ou le droit.

L'intégration de l'IA dans les outils quotidiens devient systématique. Les suites bureautiques intègrent des assistants rédactionnels. Les IDE de développement proposent l'autocomplétion intelligente de code. Les logiciels de design incorporent la génération d'images. Les CRM analysent automatiquement les interactions clients. Cette ubiquité transforme l'IA d'une technologie émergente en composant standard de l'infrastructure numérique.

L'émergence des agents autonomes représente la frontière actuelle. Ces systèmes ne se contentent plus de répondre à des requêtes ponctuelles mais peuvent planifier, exécuter des séquences d'actions complexes, utiliser des outils externes et s'adapter dynamiquement. Un agent peut par exemple analyser un marché, identifier des opportunités, rédiger un rapport et le partager avec les bonnes personnes, le tout de manière autonome.

L'IA dans le monde professionnel : usages concrets par secteur

Marketing et Communication : personnalisation à grande échelle

L'IA transforme radicalement les métiers du marketing et de la communication. La génération de contenus s'automatise partiellement : rédaction d'articles de blog, création de visuels pour les réseaux sociaux, production de vidéos courtes, adaptation de messages selon les audiences. Cette capacité permet aux équipes marketing de multiplier leur volume de production sans proportionnellement augmenter les effectifs.

L'analyse comportementale atteint une précision inédite. Les algorithmes identifient des segments d'audience ultra-fins, prédisent les intentions d'achat et détectent les signaux faibles de désengagement. Cette granularité permet une personnalisation en temps réel : le contenu, les offres et les canaux s'adaptent automatiquement à chaque prospect selon son comportement, optimisant ainsi drastiquement les taux de conversion et la satisfaction client.

Finance et Assurance : gestion des risques et détection de fraudes

Le secteur financier fut l'un des premiers adopteurs massifs de l'IA, et cette tendance s'accélère. La détection de fraude s'appuie sur des modèles capables d'analyser des millions de transactions en temps réel, d'identifier des patterns suspects invisibles à l'œil humain et de bloquer les opérations frauduleuses avant leur finalisation. Les taux de détection explosent tandis que les faux positifs diminuent.

L'analyse de risques et le scoring automatisé révolutionnent l'octroi de crédit. Les algorithmes évaluent la solvabilité en croisant des centaines de variables, identifient les profils à risque avec une précision supérieure aux méthodes traditionnelles et personnalisent les conditions selon le profil exact de chaque client. Cette automatisation accélère drastiquement les délais de décision tout en améliorant la qualité de l'évaluation.

Santé et Biotechnologies : diagnostic précoce et médecine personnalisée

L'impact de l'IA sur la santé pourrait sauver des millions de vies. L'aide au diagnostic médical progresse spectaculairement, particulièrement en imagerie. Les modèles analysent des radiographies, IRM et scanners avec une précision égale ou supérieure aux radiologues expérimentés. Ils détectent des cancers à un stade précoce, identifient des anomalies subtiles et priorisent les cas urgents.

L'analyse génomique bénéficie directement de l'IA. Le séquençage complet d'un génome génère des téraoctets de données que seuls des algorithmes peuvent analyser efficacement. L'IA identifie des mutations pathogènes, prédit les réponses aux traitements et personnalise les thérapies selon le profil génétique exact du patient, ouvrant la voie à une médecine véritablement individualisée.

Développement et IT : automatisation et assistance au code

Les développeurs comptent parmi les plus grands bénéficiaires de l'IA générative. Les assistants de code comme GitHub Copilot, Amazon CodeWhisperer ou Cursor accélèrent drastiquement l'écriture de code. Ils proposent des complétions intelligentes, génèrent des fonctions entières à partir de commentaires, traduisent entre langages de programmation et expliquent du code complexe. Cette assistance transforme profondément les pratiques de développement, donnant naissance à des approches comme le Vibe Coding où l'intention prime sur l'implémentation détaillée.

Les agents autonomes commencent à gérer des environnements cloud complets. Ils provisionnent des ressources selon la demande, optimisent les coûts en éteignant les instances inutilisées, détectent et corrigent automatiquement certaines pannes, et maintiennent la conformité avec les politiques de sécurité. Cette autonomie réduit la charge opérationnelle des équipes DevOps tout en améliorant la fiabilité des infrastructures.

Ressources Humaines : recrutement et développement des talents

Les RH adoptent progressivement l'IA pour améliorer l'efficacité de leurs processus. Le tri de CV et le matching de compétences s'automatisent : les algorithmes analysent des milliers de candidatures, identifient les profils correspondant le mieux aux critères recherchés et classent les candidats selon leur adéquation au poste. Cette automatisation accélère considérablement le recrutement sur les postes à fort volume de candidatures.

La formation personnalisée via IA adaptative révolutionne le développement des compétences. Les plateformes d'apprentissage analysent les performances de chaque apprenant, identifient ses lacunes spécifiques, adaptent le rythme et la difficulté en temps réel, et recommandent des contenus complémentaires personnalisés. Cette individualisation maximise l'efficacité pédagogique en permettant à chacun de progresser à son rythme optimal.

Industrie et Logistique : maintenance prédictive et optimisation

L'industrie 4.0 s'appuie massivement sur l'IA pour optimiser ses opérations. La maintenance prédictive analyse en continu les données des capteurs installés sur les machines (température, vibrations, consommation énergétique) et prédit les pannes avant qu'elles ne surviennent. Cette anticipation permet de planifier les interventions au moment optimal, réduisant drastiquement les arrêts non programmés et prolongeant la durée de vie des équipements.

L'optimisation des chaînes d'approvisionnement devient dynamique et réactive. Les algorithmes analysent des milliers de variables (demande, stocks, délais de transport, prix des matières premières, événements géopolitiques) pour optimiser les flux logistiques en temps réel. Ils anticipent les ruptures potentielles, proposent des routes alternatives et équilibrent coûts et délais selon les priorités métier, transformant la logistique en avantage compétitif.

Les opportunités positives de l'IA : un levier pour le bien commun

Santé : sauver des vies grâce à l'intelligence artificielle

Au-delà de l'efficacité médicale, l'IA démocratise l'accès aux soins de qualité. Les systèmes de détection précoce du cancer par analyse d'imagerie peuvent être déployés dans des régions manquant de radiologues spécialisés. Un scanner analysé par IA dans un hôpital rural isolé bénéficie de la même expertise qu'un grand centre hospitalier urbain.

La découverte de médicaments s'accélère spectaculairement. L'IA explore des milliards de combinaisons moléculaires virtuellement, identifie les candidats prometteurs et prédit leur efficacité et leurs effets secondaires avant même la synthèse physique. Des traitements qui nécessitaient une décennie de recherche peuvent désormais émerger en quelques années. Cette accélération sauve potentiellement des millions de vies face aux maladies émergentes et aux pathologies rares négligées.

Environnement et écologie : l'IA au service de la planète

La crise climatique exige des outils d'analyse et de prédiction d'une complexité inédite. Les modèles climatiques basés sur l'IA traitent des volumes massifs de données (satellites, stations météo, capteurs océaniques) pour affiner les prévisions, identifier les zones à risque et évaluer l'impact de différentes politiques environnementales. Cette modélisation avancée guide les décisions politiques et économiques vers une transition écologique efficace.

L'optimisation énergétique des bâtiments et des villes réduit drastiquement la consommation. Les algorithmes ajustent automatiquement chauffage, climatisation, éclairage selon l'occupation réelle, les prévisions météo et les tarifs énergétiques. À l'échelle urbaine, l'IA optimise les réseaux électriques, équilibre production et consommation renouvelable et réduit les pertes de distribution, diminuant ainsi l'empreinte carbone sans dégrader le confort.

Humanitaire et inclusion : réduire les inégalités

La barrière linguistique recule grâce à la traduction automatique en temps réel. Les zones multilingues, les zones de conflit accueillant des réfugiés ou les organisations internationales bénéficient d'outils permettant la communication instantanée entre locuteurs de langues différentes. Cette capacité facilite l'aide humanitaire, l'éducation et l'intégration sociale.

L'accessibilité numérique pour les personnes en situation de handicap progresse spectaculairement. Les systèmes de lecture d'images décrivent vocalement le contenu visuel pour les malvoyants. La synthèse vocale ultra-réaliste donne une voix aux personnes ne pouvant pas parler. La reconnaissance gestuelle et faciale permet le contrôle d'interfaces sans contact physique. Un exemple concret avec Head Control pour lequel HexoTech a développé une solution d'accessibilité augmentée permettant de contrôler un ordinateur avec la tête et le visage grâce à l'IA, offrant une autonomie retrouvée aux personnes à mobilité réduite.

Recherche et éducation : démocratiser la connaissance

L'IA accélère la recherche scientifique dans tous les domaines. Elle analyse la littérature scientifique mondiale, identifie des connexions entre disciplines distantes, suggère des hypothèses expérimentales et optimise les protocoles de recherche. Des découvertes qui nécessitaient des années de travail manuel émergent en quelques mois, multipliant ainsi le rythme du progrès scientifique.

Le tutorat personnalisé et l'apprentissage adaptatif révolutionnent l'éducation. Chaque élève bénéficie d'un accompagnement sur mesure : l'IA identifie ses difficultés spécifiques, adapte les explications à son style d'apprentissage, propose des exercices au bon niveau de difficulté et suit ses progrès en temps réel. Cette individualisation, impossible avec les méthodes traditionnelles à effectifs constants, améliore drastiquement les résultats éducatifs et réduit les inégalités d'accès à une éducation de qualité.

Enjeux éthiques et défis à relever

L'essor de l'IA soulève des questions éthiques fondamentales qui nécessitent une attention constante. Les biais algorithmiques reproduisent et parfois amplifient les discriminations présentes dans les données d'entraînement. Un système de recrutement peut perpétuer des inégalités de genre, un algorithme de crédit défavoriser certaines populations. La détection et la correction de ces biais exigent vigilance, diversité dans les équipes de développement et audits réguliers.

La protection des données et la souveraineté numérique deviennent stratégiques. L'entraînement des modèles nécessite des volumes massifs de données, soulevant des questions sur qui contrôle ces données, où elles sont stockées et comment elles sont protégées. Les initiatives européennes comme Mistral AI visent à garantir une indépendance technologique face aux géants américains et chinois.

L'impact sur l'emploi et la transformation des compétences constitue un défi social majeur. Certains métiers disparaissent, d'autres émergent, la plupart évoluent. Les tâches répétitives s'automatisent rapidement. Cette transformation exige une adaptation massive : la créativité, le jugement éthique, l'intelligence émotionnelle et la capacité à collaborer avec l'IA deviennent centraux.

Pour approfondir ces enjeux et développer une compréhension solide des implications de l'IA, notre article sur la littératie en IA explore en détail les questions de transparence, d'explicabilité, de gouvernance et d'utilisation responsable de ces technologies.

Conclusion : Une technologie à maîtriser, pas à craindre

L'intelligence artificielle n'est ni une menace existentielle ni une solution miracle. C'est un outil puissant dont l'impact dépend entièrement de la manière dont nous choisissons de le développer, de le réguler et de l'utiliser. L'IA fonctionne mieux comme outil d'augmentation humaine : elle amplifie nos capacités cognitives, automatise les tâches fastidieuses et nous libère pour les activités créatives et stratégiques.

L'histoire de l'IA, de Turing aux agents autonomes actuels, montre une accélération constante. Les sept dernières décennies ont transformé des concepts théoriques en outils quotidiens utilisés par des milliards de personnes. Cette démocratisation se poursuivra, rendant l'IA toujours plus accessible et performante.

Face à cette évolution inéluctable, trois piliers deviennent essentiels. L'éducation doit préparer chacun à travailler efficacement avec l'IA, comprendre ses capacités et ses limites, et développer les compétences complémentaires. La régulation doit encadrer l'usage de l'IA pour prévenir les dérives et protéger les droits fondamentaux. L'innovation responsable doit guider les développeurs et les entreprises vers des applications créant de la valeur partagée.

Chez HexoTech, nous vous accompagnons dans cette transformation

La maîtrise de l'IA ne s'improvise pas. Elle exige une compréhension des fondamentaux, une pratique guidée et une montée en compétence progressive adaptée à votre contexte professionnel.

Notre formation Initiation à l'IA s'adresse à tous les professionnels souhaitant comprendre cette technologie et l'utiliser efficacement. Elle couvre la littératie en IA (comprendre ce qu'est vraiment l'IA, ses capacités et ses limites), le Prompt Engineering (communiquer efficacement avec les modèles) et les enjeux éthiques et de gouvernance. Cette formation vous donne l'autonomie nécessaire pour exploiter l'IA dans votre quotidien professionnel.

Notre formation IA pour équipes de développement va plus loin en structurant l'intégration de l'IA dans les processus techniques. Elle aborde le Vibe Coding, l'automatisation assistée par IA, la qualité logicielle face au code généré, la documentation intelligente et la gouvernance des outils IA dans les équipes. Cette formation transforme l'IA en avantage compétitif durable pour vos projets de développement.

Contactez nous pour découvrir comment nous pouvons adapter ces formations à votre contexte et accompagner vos équipes vers une maîtrise complète de l'intelligence artificielle.

FAQ :

IA et transformation professionnelle

L'IA va-t-elle remplacer les développeurs et autres professionnels qualifiés ?

L'IA transforme les métiers plus qu'elle ne les remplace. Elle automatise les tâches répétitives mais crée de nouvelles opportunités pour les compétences créatives, stratégiques et relationnelles. Les professionnels qui maîtrisent l'IA comme outil d'augmentation deviennent exponentiellement plus productifs et restent indispensables.

Comment choisir entre les différents modèles d'IA disponibles (GPT, Claude, Gemini, etc.) ?

Le choix dépend de votre cas d'usage, de vos contraintes de confidentialité et de votre budget. Certains modèles excellent en code, d'autres en raisonnement complexe ou en créativité. L'idéal est d'expérimenter plusieurs options pour identifier celle qui correspond le mieux à vos besoins spécifiques.

Quels sont les risques de sécurité liés à l'utilisation de l'IA en entreprise ?

Les principaux risques incluent la fuite de données confidentielles via les prompts, la génération de code avec des vulnérabilités, la dépendance à des fournisseurs externes et les biais dans les décisions automatisées. Une gouvernance claire, des formations adaptées et des audits réguliers mitiguent efficacement ces risques.

Faut-il des compétences techniques pour utiliser l'IA efficacement ?

Non pour l'utilisation basique. Le Prompt Engineering et l'exploitation des outils grand public ne nécessitent aucune compétence en programmation. En revanche, l'intégration avancée dans des workflows techniques ou le développement de solutions personnalisées exigent une expertise technique spécifique.

Comment l'Europe peut-elle rester compétitive face aux géants américains et chinois de l'IA ?

Par la souveraineté technologique (développer des modèles et infrastructures européens comme Mistral AI), l'excellence dans des niches spécifiques (IA de confiance, IA frugale, IA explicable), une régulation intelligente qui protège sans étouffer l'innovation, et l'investissement massif dans la formation pour créer les compétences nécessaires.